Gesten-basierte Interaktion mit virtuellen 3D Umgebungen

| Leitung: | Colin Fischer |

| Team: | Florian Politz |

| Jahr: | 2016 |

| Laufzeit: | 2016 |

| Ist abgeschlossen: | ja |

Mit der Verfügbarkeit immer leistungsfähigerer Rechentechnik im privaten/Freizeit-Sektor ist vor wenigen Jahren auf dem Technologiemarkt ein Wettrüsten zur Entwicklung erschwinglicher Virtual-Reality- (VR) und Augmented-Reality-Hardware ausgebrochen, um potenzielle Märkte insbesondere für realitätsnahe Darstellung von 3D-Inhalten (bspw. Computerspiele) zu erschließen. Kern dieser Technologie ist die Aufbereitung dreidimensionaler Information in Form von 2D-Stereobild-Paaren, die über geeignete Ausgabe-Hardware (Brillen/Helme) konsumiert werden können. Dieses Prinzip lässt sich jedoch auch anderweitig nutzen, beispielsweise zur besseren Exploration von bzw. Interaktion mit räumlichen 3D-Daten.

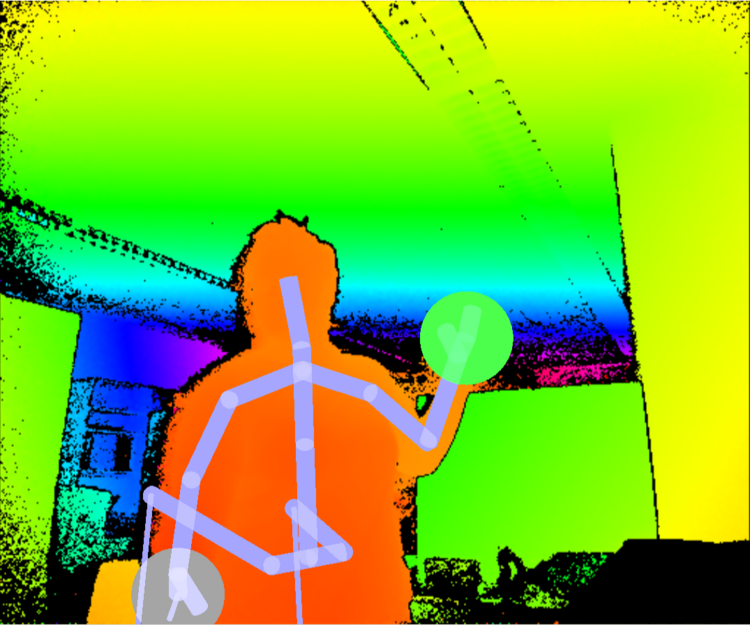

Im Rahmen dieser Masterarbeit wurde eine VR-Umgebung (VR) realisiert, in der sich Nutzer in eine durch Laserscanning erfasste Szene hineinversetzt wird und sich durch Körpergesten frei in dieser bewegen kann und mit der Punktwolke interagieren kann, also beispielsweise Objekte durch eine Zeigebewegung selektieren kann, um sie anschließend aus der Szene zu löschen oder Labels im Rahmen einer Klassifikationsaufgabe zu vergeben. Die realitätsnahe Darstellung erleichtert dem Nutzer die Einschätzung der realen Situation und unterstützt damit seine Entscheidungen.

Zur Umsetzung der VR-Umgebung wurde die Spiele-Engine Unity 5 verwendet, die wiederum die VR-Brille Oculus Rift DK2 für die Darstellung der Punktwolke nutzt. Für die gestenbasierte Steuerung wird eine Microsoft Kinect 2 genutzt, über die vorab trainierte Körpergesten des Nutzers in Echtzeit detektiert wird, wodurch eine vollständig berührungslose Interaktion mit den Daten möglich wird.

Datengrundlage für die Umgebung sind Punktwolkendatensätze aus einem mobile mapping System (Laserscanning). Hierbei wurde bei der Realisierung auf eine gute Skalierbarkeit mit der Datenmenge geachtet: die in Kacheln organisierten Daten werden anlassbezogen dynamisch in den Hauptspeicher geladen bzw. aus diesem wieder entfernt. Hierbei können Informationen über eine Vorab-Segmentierung der enthaltenen Daten innerhalb der VR-Umgebung berücksichtigt werden, wodurch eine Interaktion auf Objektebene (statt auf einzelpunkten) möglich wird.